Production & Reliability

Deploying AI in production: guardrails, monitoring, latency, and cost.

Guide & Approfondimenti

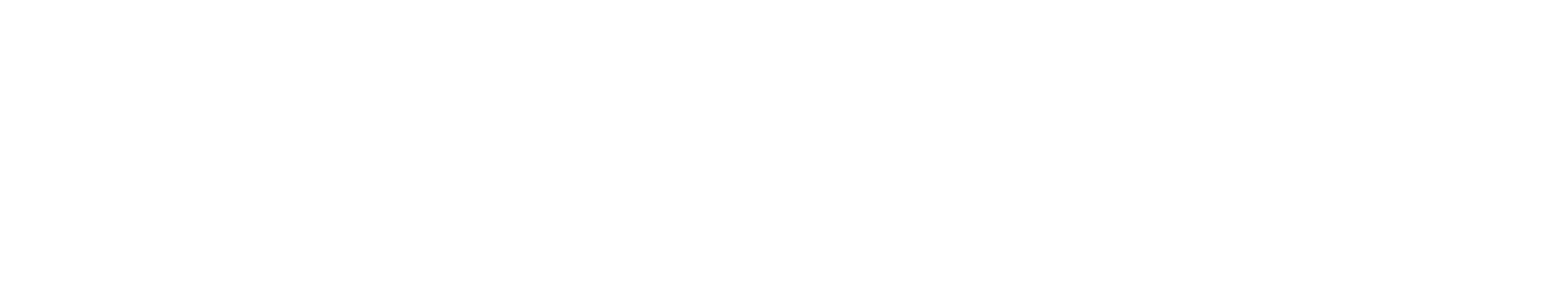

Vibe coding gets you a demo, not a production SaaS

Vibe coding can ship a working prototype fast, but a production-ready SaaS needs more: authentication, tenant isolation, secrets management, billing logic, observability, compliance, and support.

GDPR nei sistemi AI: 5 errori iniziali che moltiplicano rework e costi

Perché il GDPR nei progetti GenAI non è un peso legale, ma una scelta architetturale. Scopri come evitare il rework costoso su corpus, accessi e log.

LLM costs aren’t a pricing problem: it’s architecture

Most LLM spend is hidden in debugging, retries, and observability. Why agentic RAG gets expensive and how hybrid SLM routing restores control.

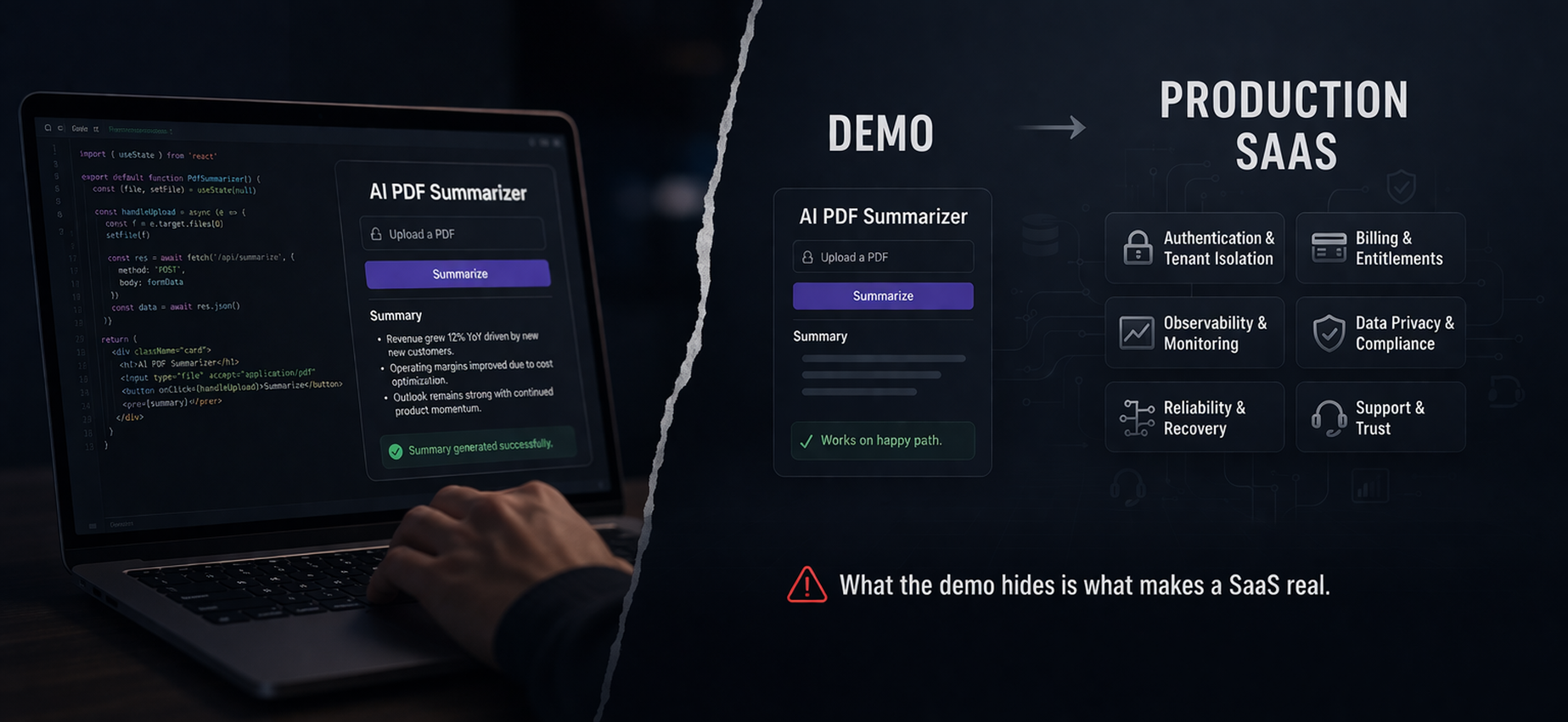

RAGCache: Enhancing Efficiency in Retrieval-Augmented Generation

Discover how RAGCache optimizes Retrieval-Augmented Generation by reducing latency and improving throughput, enabling more efficient AI applications

KnockKnock: Automate Your Machine Learning Notifications with Ease

Automate machine learning notifications with KnockKnock, a Python library that integrates with Desktop, Telegram, Email, and Slack. Save time and monitor your training scripts efficiently

Model deployment

How many times did you build up a great machine learning model that never seen the light? This is the right article for you!